数据孤岛问题如何解决?这是数据驱动以及人工智能时代下,诸多互联网公司乃至科技公司非常棘手的问题。不过,最近一项人工智能标准制定的推进,或许将改变这种现状。

今年年初,首个AI协同及大数据安全国际标准在IEEE联邦学习标准制定委员会的推动下,在深圳召开了工作组第一次会议。其中,创新工场南京国际人工智能研究院执行院长冯霁代表创新工场当选为IEEE联邦学习标准制定委员会副主席,共同着手推进制定AI协同及大数据安全领域首个国际标准。

4月11日,创新工场人工智能工程院执行院长王咏刚以及冯霁围绕该标准回答了媒体记者提问。

首个AI协同及大数据安全国际标准是什么?

据悉,IEEE联邦学习标准项目是国际上首个针对人工智能协同技术框架订立标准的项目,由国际著名人工智能学者杨强教授领衔担任主席。

除了创新工厂之外,目前已有30余个互联网巨头公司、政府单位、企业和高校参与到标准制定工作中,仅国内参与方就包含中国电信、腾讯、京东、小米、微众银行、顺丰、平安一账通、招商金科、深圳市标准技术研究院、香港科技大学、香港理工大学等。

那么,何为联邦学习?

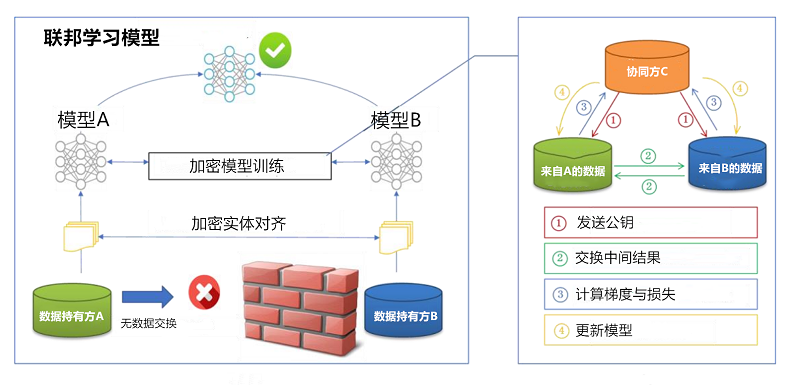

王咏刚以“黑洞”为例,他表示联邦学习就像一个安全的、友好的,既能保证黑洞之间顺利交换数据,又不会破坏数据安全、个人隐私的“桥梁”,它可以在两个或多个参与的“黑洞”之间,训练出最好的模型,同时又不让黑洞之间互相暴露原始数据。

冯霁进一步阐释道,“联邦学习不是边缘技术,而是一种比较新的前沿技术,它主要解决分布式框架下数据隐私保护的问题。换言之,如何在不分享数据的前提下,从数据中获得的知识。”

综上所述,联邦学习可以通过加密机制下的参数交换方式,在不违反数据隐私保护法规的情况下,建立一个共有模型。在建立模型的时候,数据本身不移动,也不会泄露用户隐私或影响数据规范。它为人工智能领域绝大多数需要训练数据聚合、交换的场景,提供了目前最完整的技术体系支持。

作为标准委员会的副主席,冯霁透露,按照正常进度,IEEE联邦学习标准将在两年内推出。

这个标准意味着什么?

随着目前各国数据隐私保护法律的出台,对联邦学习技术的需求逐渐成为国际共识。而一项重要的技术,更需要一个国际标准进行规范和约束。

冯霁表示,这个AI标准的制定意味着未来各家机构在开发针对数据隐私保护的人工智能系统时,可以有一个纲领性的指导文件。另外它也会帮助立法机构在涉及隐私保护的问题中提供一个技术参考。

图 | 创新工场南京国际人工智能研究院执行院长冯霁

企业之外,对于普通人来说,联邦学习也像一个安全的道路网络,可以既满足人工智能的训练要求,又保障我们的个人隐私不被滥用。

王咏刚举例:未来我们喜欢什么网页、买过什么东西等隐私信息在联邦学习的支持下,可以只保存在我自己的手机里,完全不用上传到任何服务器或云端。同时,那些做个性化推荐的电子商城可以只根据无法还原到隐私的加密信息,训练出最好的预测模型,做到供应链管理的最优化,降低零售渠道成本。

最后,冯霁透露目前委员会刚成立,在未来会从技术、法律等多方面共同努力,达成标准共识。“我们初步定在6月15日于美国加州召开第二次委员会,届时各家机构将会进一步探讨标准的细节”

而像创新工场这样的中国企业参与到人工智能国际标准的制定中,也代表着国内企业在全球话语权的提升,更加助于更多的国内企业尽早部署和研发具备隐私保护的人工智能系统。

(审核编辑: 林静)